Sdü Optimizasyon Teorisi ve Teknikleri 20.11.2017 ders notu

Sdü Optimizasyon Teorisi ve Teknikleri 20.11.2017 ders notu

Örnek1-Aşağıdakilerden hangileri doğrudur ?

a) Direk arama yöntemleri aotimizasyon fonksiyonu farklılaşmadığı zaman kullanılır.(Doğru)

b)Gradient f(x,y) x, y e ait en dik boşluktur.(Doğru)

c)Hessian bir Jacobian matrisidir.(İkinci derecen türev)(Doğru)

d)Optimizasyon fonksiyonunun ikinci derece türevi optimal noktayıbelirtmek için kullanılır.(Yanlış)

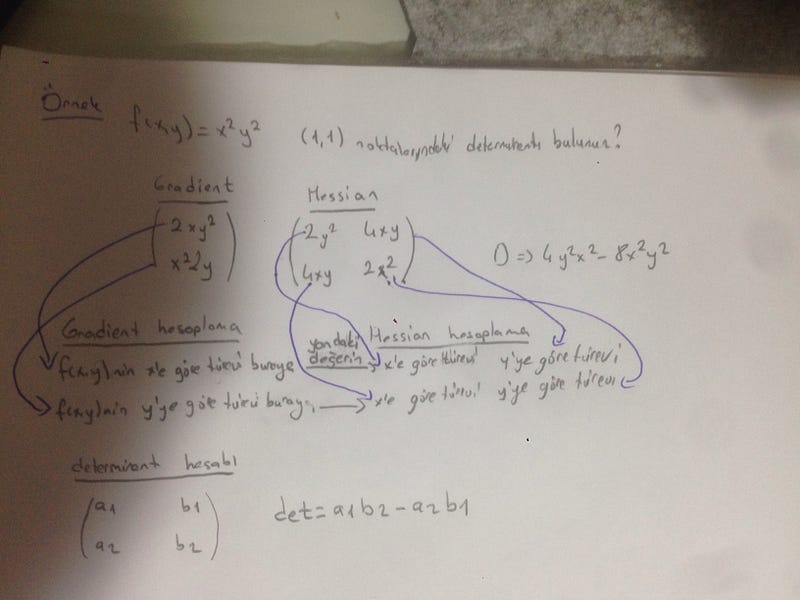

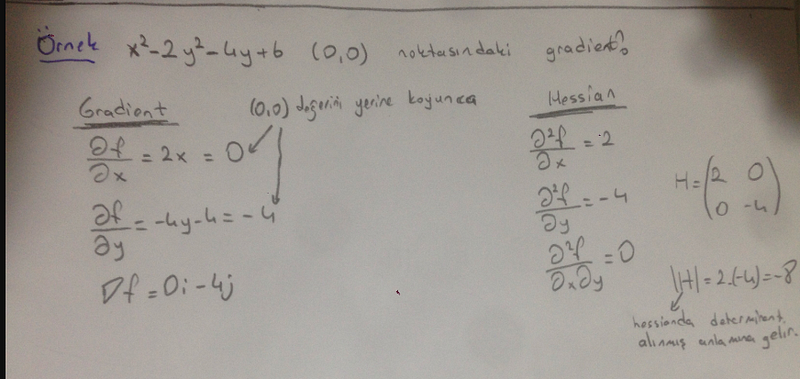

Çok Boyutlu Parçaçık Metotları(Multidimensional Gradient Methods)

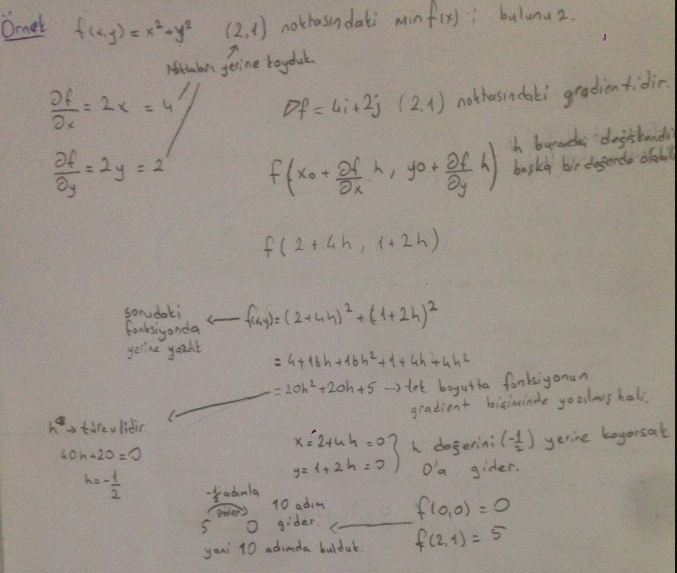

a.) Steepest Descent Metodu

b.) Newton Raphson Metodu

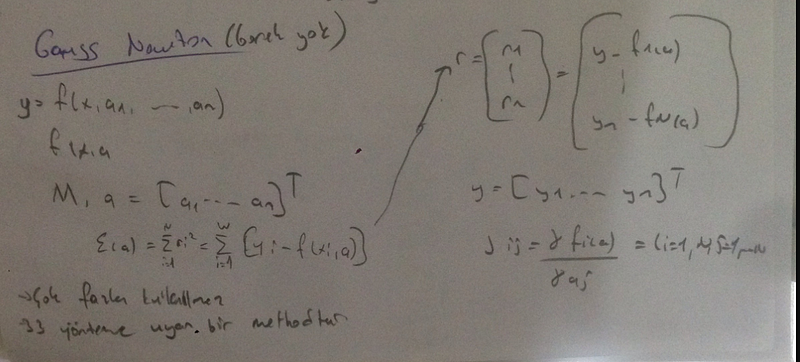

c.) Gauss Metodu

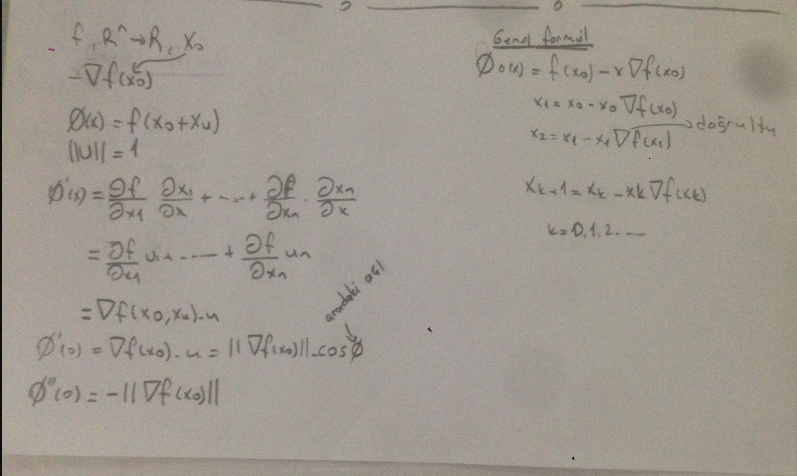

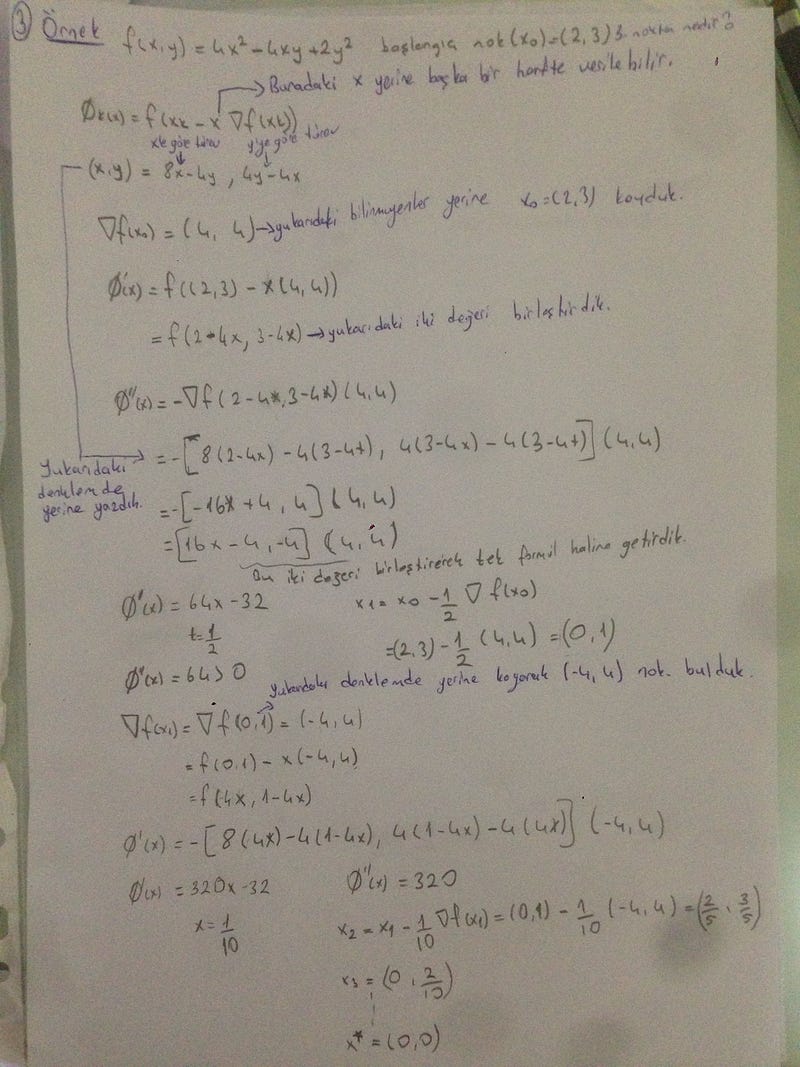

Steepest Descent Metodu

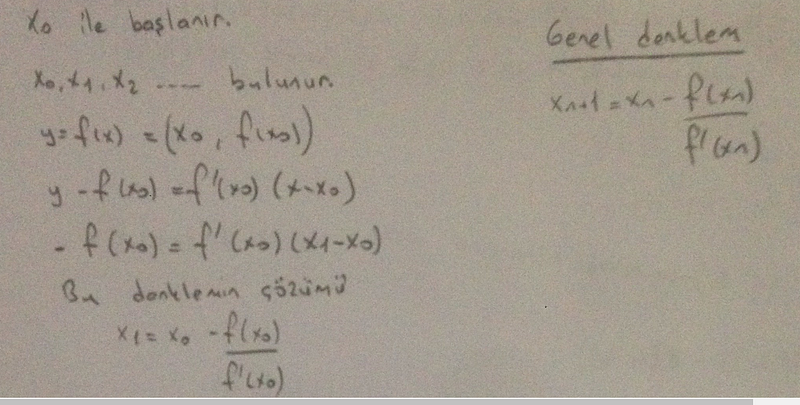

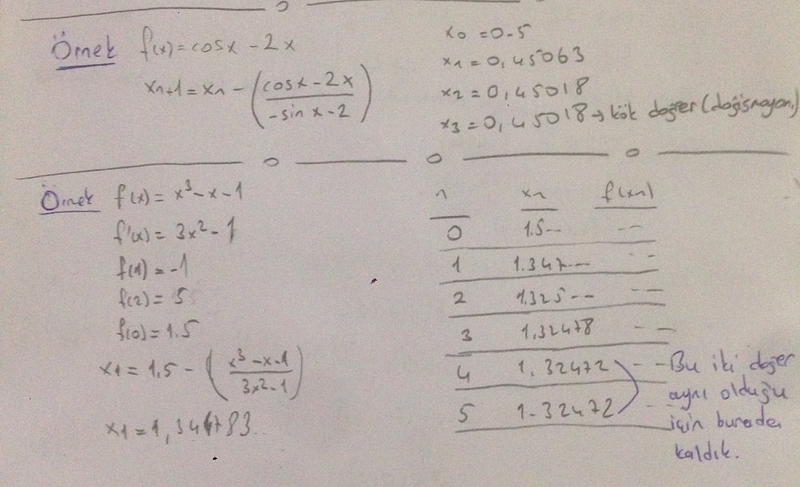

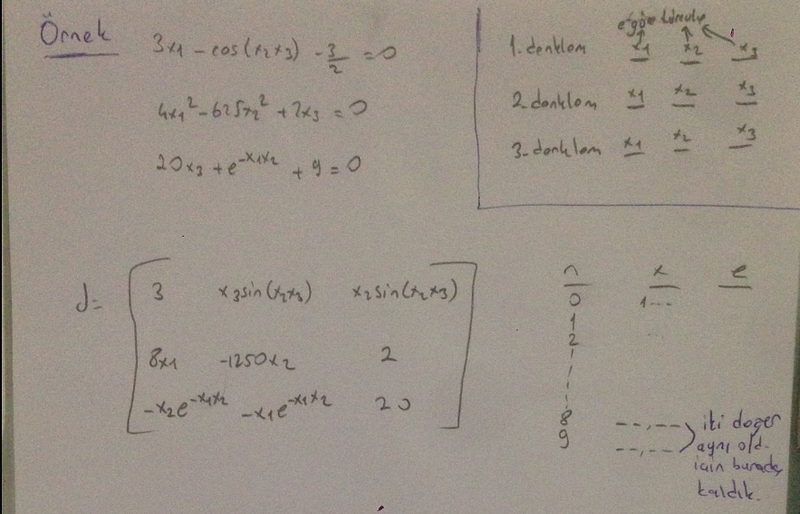

Newton Raphson Metodu

f(x) = 0 formundaki denklemleri çözmek için kullanılır.

Taylor Serisi buradaki linkten ne olduğuna bakabilrsiniz.

Gauss Metodu